麒麟ARM服务器【局域网部署ollama+deepseek】

一、基础信息

CPU:鲲鹏920

操作系统:V10-SP3-2403-ARM64

相关软件可以从官网上下载,也可以从这里获取:https://www.jianguoyun.com/p/DeAiMR4Qn9eQDBiNqOoFIAA

二、替换系统libstdc++.so.6

(ARM服务器才需要替换,x86的不用)

- 从上面链接里下载libstdc++.so.6.0.28文件,复制到/usr/lib64目录里

cp libstdc++.so.6.0.28 /usr/lib64/ - 备份旧的软链接,并创建新的软链接

cp -P libstdc++.so.6 libstdc++.so.6.bak ln -sf /usr/lib64/libstdc++.so.6.0.28 /usr/lib64/libstdc++.so.6

三、安装ollama

-

安装(解压):

sudo tar -C /usr -xzf ollama-linux-amd64.tgz -

创建ollama用户 (非必须)

useradd -r -s /bin/false -m -d /usr/share/ollama ollama -

创建模型目录 (非必须)

sudo mkdir -p /data/soft/ollama/.ollama/models sudo chown -R ollama:ollama /data/soft/ollama/.ollama -

创建ollama服务文件:

vim /etc/systemd/system/ollama.service[Unit] Description=Ollama Service #After=network-online.target # [Service] ExecStart=/usr/bin/ollama serve User=ollama Group=ollama Restart=always RestartSec=3 Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/root/bin" #代表让ollama能识别到第几张显卡 #Environment="CUDA_VISIBLE_DEVICES=0,1" #这几张卡均衡使用 #Environment="OLLAMA_SCHED_SPREAD=1" #模型一直加载, 不自动卸载 Environment="OLLAMA_KEEP_ALIVE=-1" #配置远程访问 Environment="OLLAMA_HOST=0.0.0.0" #配置跨域请求 Environment="OLLAMA_ORIGINS=*" #配置OLLAMA的模型存放路径,默认路径是/usr/share/ollama/.ollama/models/ Environment="OLLAMA_MODELS=/data/soft/ollama/.ollama/models" [Install] WantedBy=default.target -

启动ollama服务

# 重新加载 systemd配置文件 systemctl daemon-reload # 重启 ollama 服务 systemctl restart ollama # 开机启动 ollama 服务 systemctl enable ollama -

防火墙放行端口

firewall-cmd --zone=public --add-port=11434/tcp --permanent

四、下载deepseek模型:

- 在线下载

ollama pull deepseek-r1:1.5b ollama pull deepseek-r1:7b ollama pull deepseek-r1:14b - 离线下载安装

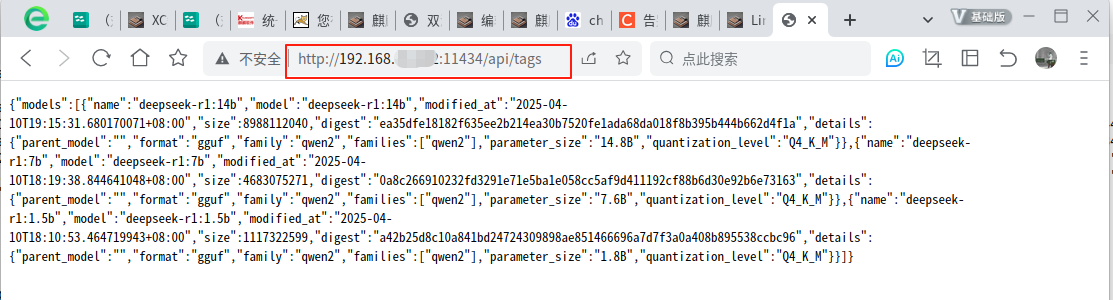

五、测试

-

终端测试

curl http://192.168.xx.xx:11434/api/tags -

浏览器测试

-

curl对话测试

curl http://172.16.1.100:11434/api/chat \ -X POST \ -H "Content-Type: application/json" \ -d '{ "model": "qwen3:8b", "messages": [ { "role": "user", "content": "你是谁?" } ], "stream": true }'

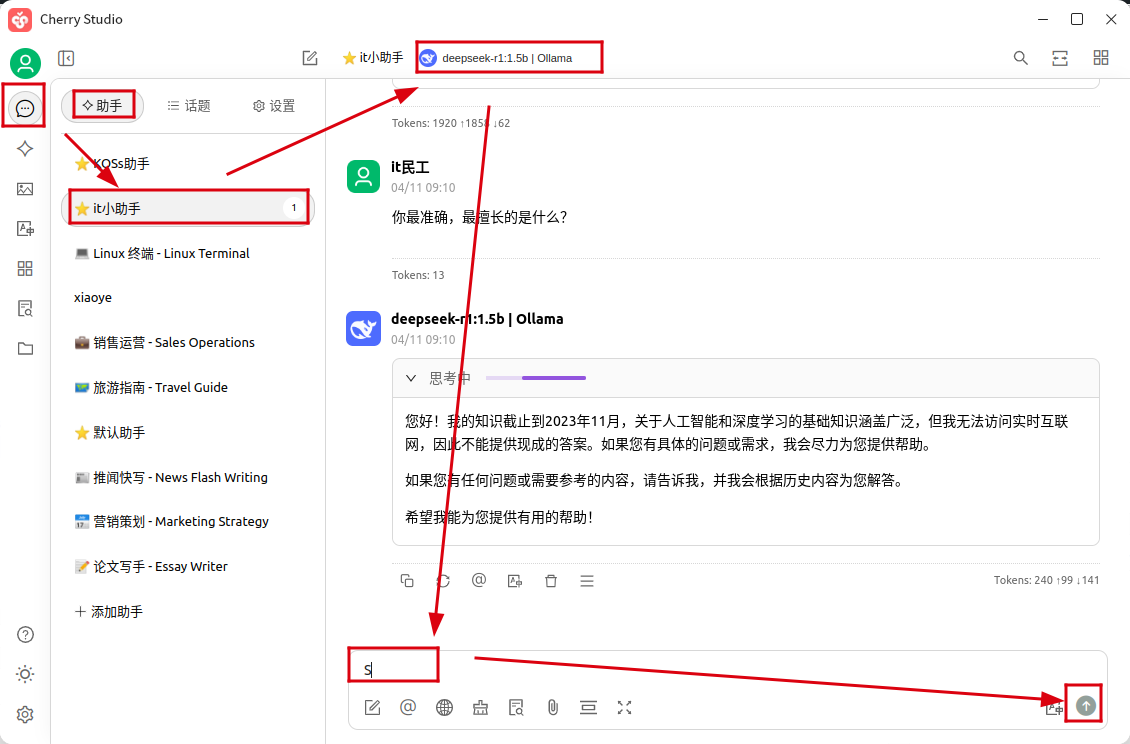

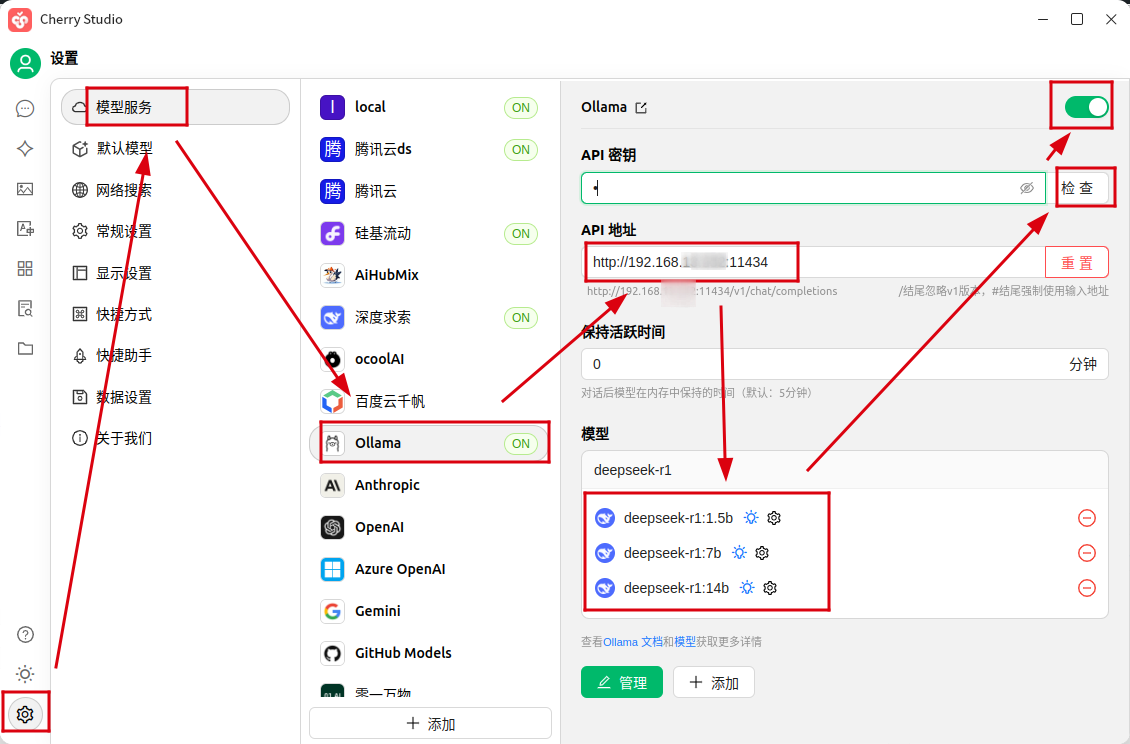

六、客户端连接使用

- cherry studio

就可以使用了