麒麟桌面系统SP1【本地安装使用deepseek】

这里使用ollama+deepseek+Chatbox的方案,本地部署deepseek

(实测arm架构也可用,安装和部署方法一样)

一、下载相关软件

使用到的相关软件,可以从以下软件的官网上获取

-

ollama官网链接(www.ollama.com)

-

chatbox官网链接:(www.chatboxai.app)

二、安装ollama

-

安装命令如下(实际上就是把文件解压到/usr目录下):

sudo tar -C /usr -xzf ollama-linux-amd64.tgz -

启动ollama

启动命令如下:

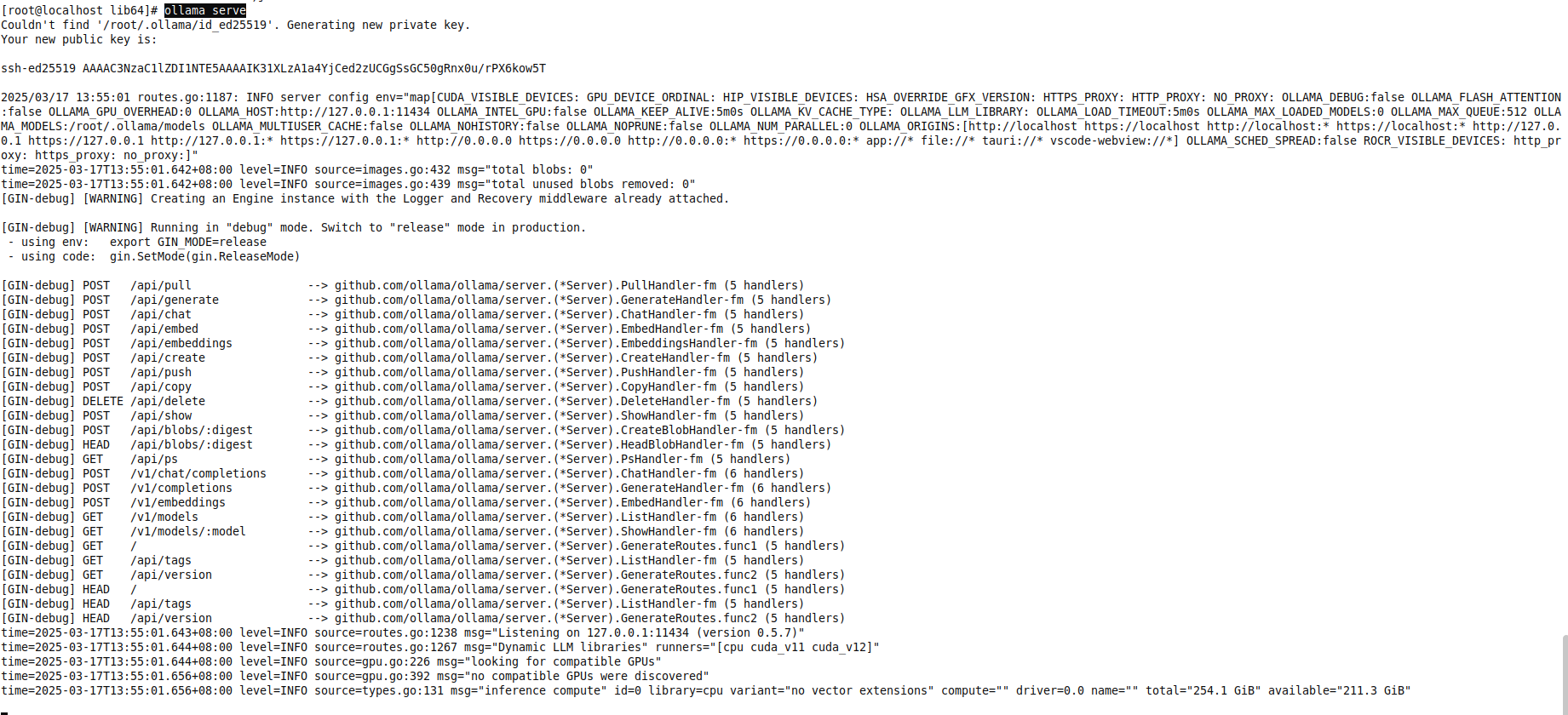

ollama serveArm服务器会报错,处理方法见文末 -

ollama官网手册:

https://github.com/ollama/ollama/blob/main/docs/linux.md

如果需要了解更多关于ollama使用的命令及说明,可以点击ollama官网链接查看。

二、通过ollama拉取并运行deepseek-r1模型

如果显卡较好的,可以运行7b 、8b、14b、32b等版本,以下是运行1.5b模型的命令:

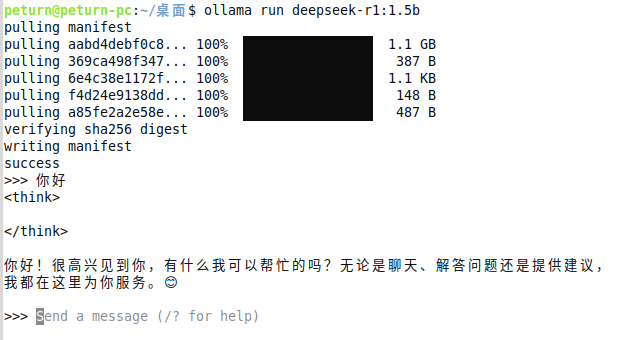

ollama run deepseek-r1:1.5b如下图所示:

- 如上图所示,已经成功拉取并可以与deepseek对话了;

- 如果需要运行其他版本,可以将命令时的1.5b修改民需要的版本,比如8b,则执行以下命令:

ollama run deepseek-r1:8b注意:现在太多人部署和访问,导致下载较慢,需要耐心等待,如果下载出错,建议重新执行命令拉取,直致成功。

三、安装chatbox

经以上操作后虽然已经可以使用deepseek,但是终端的交互让聊天很不方便,可以使用chatbox、open-webui、page_assist插件等使用,这里以chatbox为例:

-

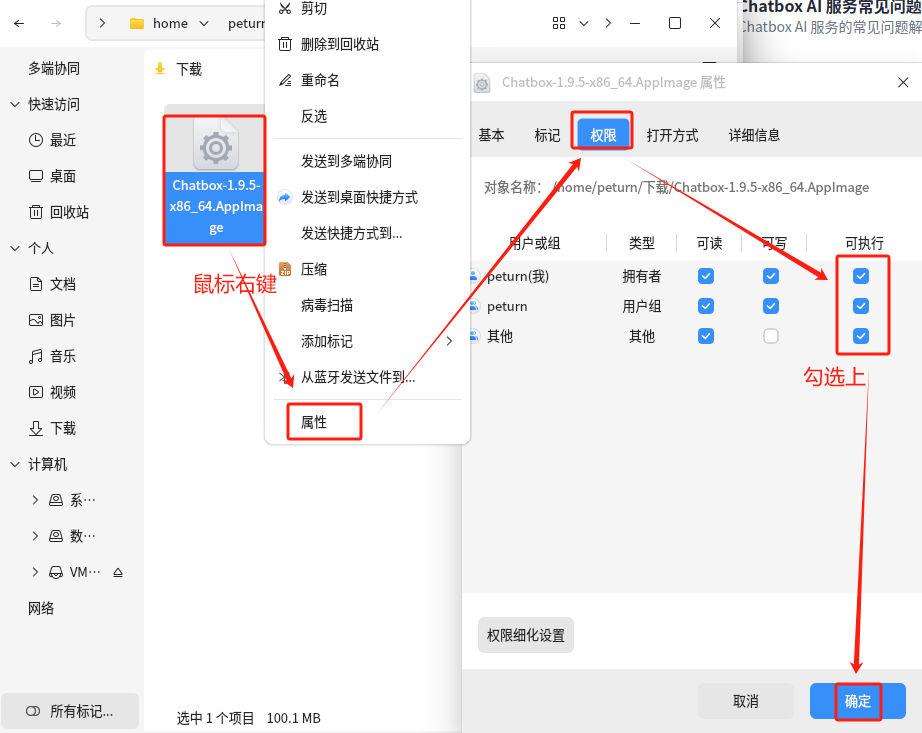

给前面下载好的chatbox-文件,设置可执行权限:

-

双击运行,第一次运行会自动跳出设置界面:

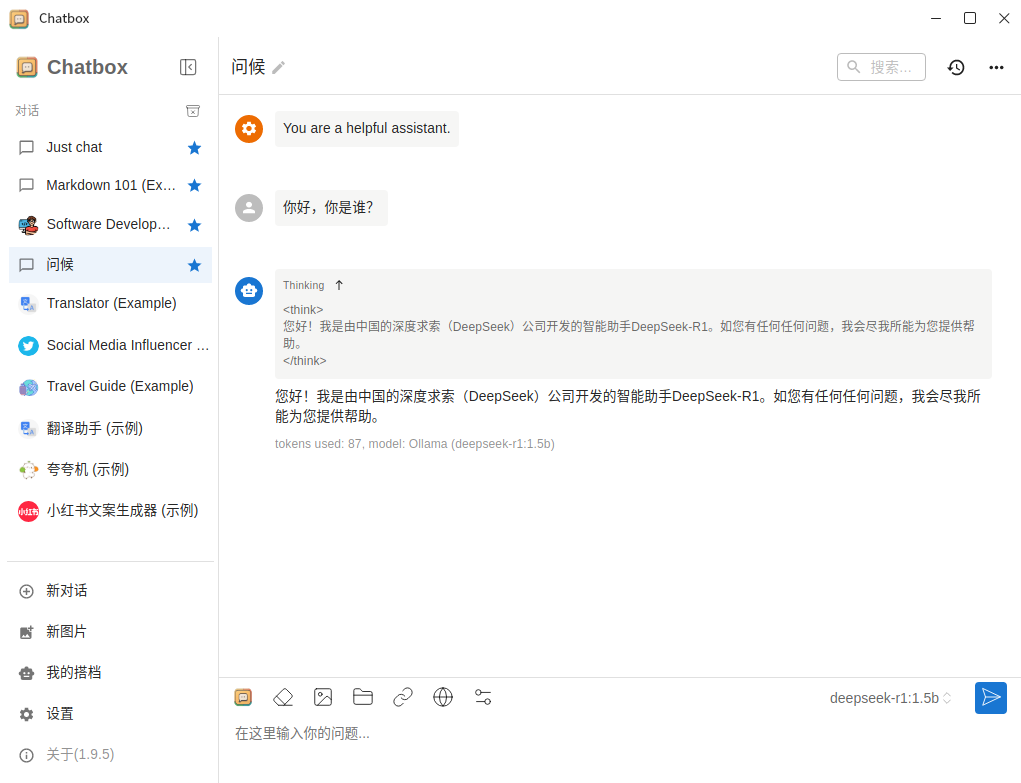

保存后就可以正常使用了,如下图所示:

常见问题

-

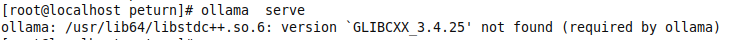

麒麟arm服务器操作系统上可能会报以下信息:

需要更换libstdc++.so.6.0.28文件,文件下载地址:https://www.jianguoyun.com/p/DeAiMR4Qn9eQDBiNqOoFIAA#dir=%2Fkos-server-arm-deepseek::mode=0

替换命令:# 将下载的文件移动到 /usr/lib64/ 目录下 mv libstdc++.so.6.0.28 /usr/lib64/libstdc++.so.6.0.28 # 替换软链接 ln -sf /usr/lib64/libstdc++.so.6.0.28 /usr/lib64/libstdc++.so.6不用重启系统,执行

ollama serve正常运行如下图所示:

其他

-

列出已安装的模型

curl http://localhost:11434/api/tags -

调用模型测试

curl -X POST http://localhost:11434/api/generate \ -H "Content-Type: application/json" \ -d '{ "model": "deepseek-r1:1.5b", "prompt": "hello", "stream": true }'

没有mips架构的安装方法吗?

ollama好像没有mips架构的,而且mips性能也不太够,就不折腾了,但是龙芯这边是有loongarch架构上的方案的。